회고

어제보다 더 쫓기는 오늘입니다.

이번주는 수요일부터 몸살 감기가 와서 너무 힘들었어요.

한편으로는 대회 안할 때 미리 아파서 다행이긴 한데 얼른 나았으면 좋겠네요.

글을 쓰는 지금도 정신이 혼미하네요

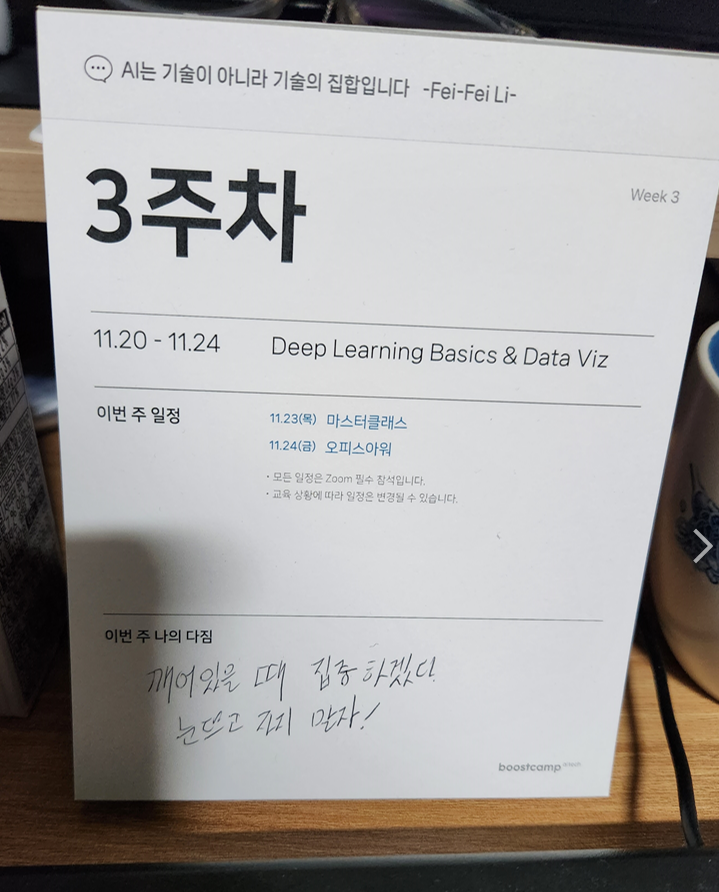

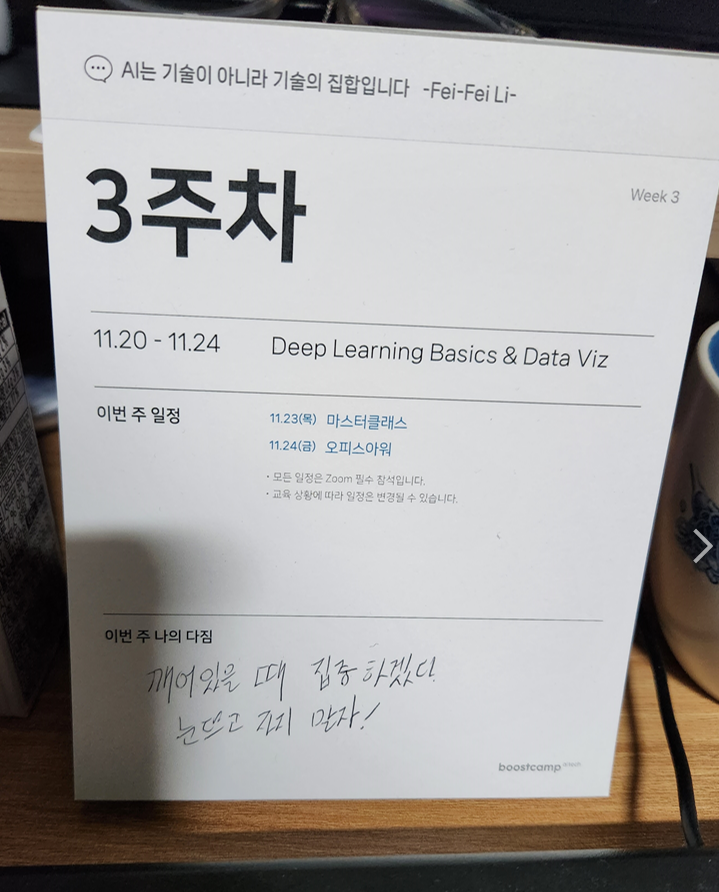

이번주 수업은 딥러닝 베이직과 Data Viz였습니다.

강의 관련

https://callmescone.tistory.com/365

가중치 초기화 (Weight Initialization)

Weight decay Parameter Norm Penalty Overfitting 방지 Weight 를 작게 유지하여 Function Space를 Smooth 하게 함.( For Generalization Performance ) 작게 유지? 가중치의 초깃값을 0으로 설정하면 어떨까? Zero Initialization 모든

callmescone.tistory.com

https://callmescone.tistory.com/366

[딥러닝 기초 다지기] 부트캠 day-15

인공지능? 머신러닝? 딥러닝? A Historical Review chatgpt 시대 이전, 딥리닝의 패러다임슈트에 대해 알아보자. NNs Loss Functions 딥러닝 용어 Gradient Descent Optimizer Regularization 출처 : boostcamp 최성준 교수님

callmescone.tistory.com

https://callmescone.tistory.com/367

[Transformer & Generative Models] 부트캠 day-17

Transformer Transformer https://jalammar.github.io/illustrated-transformer/ The Illustrated Transformer Discussions: Hacker News (65 points, 4 comments), Reddit r/MachineLearning (29 points, 3 comments) Translations: Arabic, Chinese (Simplified) 1, Chinese

callmescone.tistory.com

정리

이번주 주말에는 미처 못한 심화과제와 기본과제 복습 등을 진행하고

깃헙 공부와 운영체제 공부를 할까 합니다.

다음주는 이번주보다 더 좋은 컨디션으로 회고를 작성하길 바라며 이만 마치겠습니다.

'근황 토크 및 자유게시판' 카테고리의 다른 글

| [Naver Boost Camp] Week 9 ObjectDetection Competition 준비 (0) | 2024.01.05 |

|---|---|

| [Naver Boost Camp] Week 4 후기 (0) | 2023.12.01 |

| [Naver Boost Camp] Week 2 후기 (0) | 2023.11.17 |

| Hype Cycle for Emerging Tech - Gartner (0) | 2023.11.12 |

| [Naver Boost Camp] Week 1 후기 (0) | 2023.11.10 |

회고

어제보다 더 쫓기는 오늘입니다.

이번주는 수요일부터 몸살 감기가 와서 너무 힘들었어요.

한편으로는 대회 안할 때 미리 아파서 다행이긴 한데 얼른 나았으면 좋겠네요.

글을 쓰는 지금도 정신이 혼미하네요

이번주 수업은 딥러닝 베이직과 Data Viz였습니다.

강의 관련

https://callmescone.tistory.com/365

가중치 초기화 (Weight Initialization)

Weight decay Parameter Norm Penalty Overfitting 방지 Weight 를 작게 유지하여 Function Space를 Smooth 하게 함.( For Generalization Performance ) 작게 유지? 가중치의 초깃값을 0으로 설정하면 어떨까? Zero Initialization 모든

callmescone.tistory.com

https://callmescone.tistory.com/366

[딥러닝 기초 다지기] 부트캠 day-15

인공지능? 머신러닝? 딥러닝? A Historical Review chatgpt 시대 이전, 딥리닝의 패러다임슈트에 대해 알아보자. NNs Loss Functions 딥러닝 용어 Gradient Descent Optimizer Regularization 출처 : boostcamp 최성준 교수님

callmescone.tistory.com

https://callmescone.tistory.com/367

[Transformer & Generative Models] 부트캠 day-17

Transformer Transformer https://jalammar.github.io/illustrated-transformer/ The Illustrated Transformer Discussions: Hacker News (65 points, 4 comments), Reddit r/MachineLearning (29 points, 3 comments) Translations: Arabic, Chinese (Simplified) 1, Chinese

callmescone.tistory.com

정리

이번주 주말에는 미처 못한 심화과제와 기본과제 복습 등을 진행하고

깃헙 공부와 운영체제 공부를 할까 합니다.

다음주는 이번주보다 더 좋은 컨디션으로 회고를 작성하길 바라며 이만 마치겠습니다.

'근황 토크 및 자유게시판' 카테고리의 다른 글

| [Naver Boost Camp] Week 9 ObjectDetection Competition 준비 (0) | 2024.01.05 |

|---|---|

| [Naver Boost Camp] Week 4 후기 (0) | 2023.12.01 |

| [Naver Boost Camp] Week 2 후기 (0) | 2023.11.17 |

| Hype Cycle for Emerging Tech - Gartner (0) | 2023.11.12 |

| [Naver Boost Camp] Week 1 후기 (0) | 2023.11.10 |