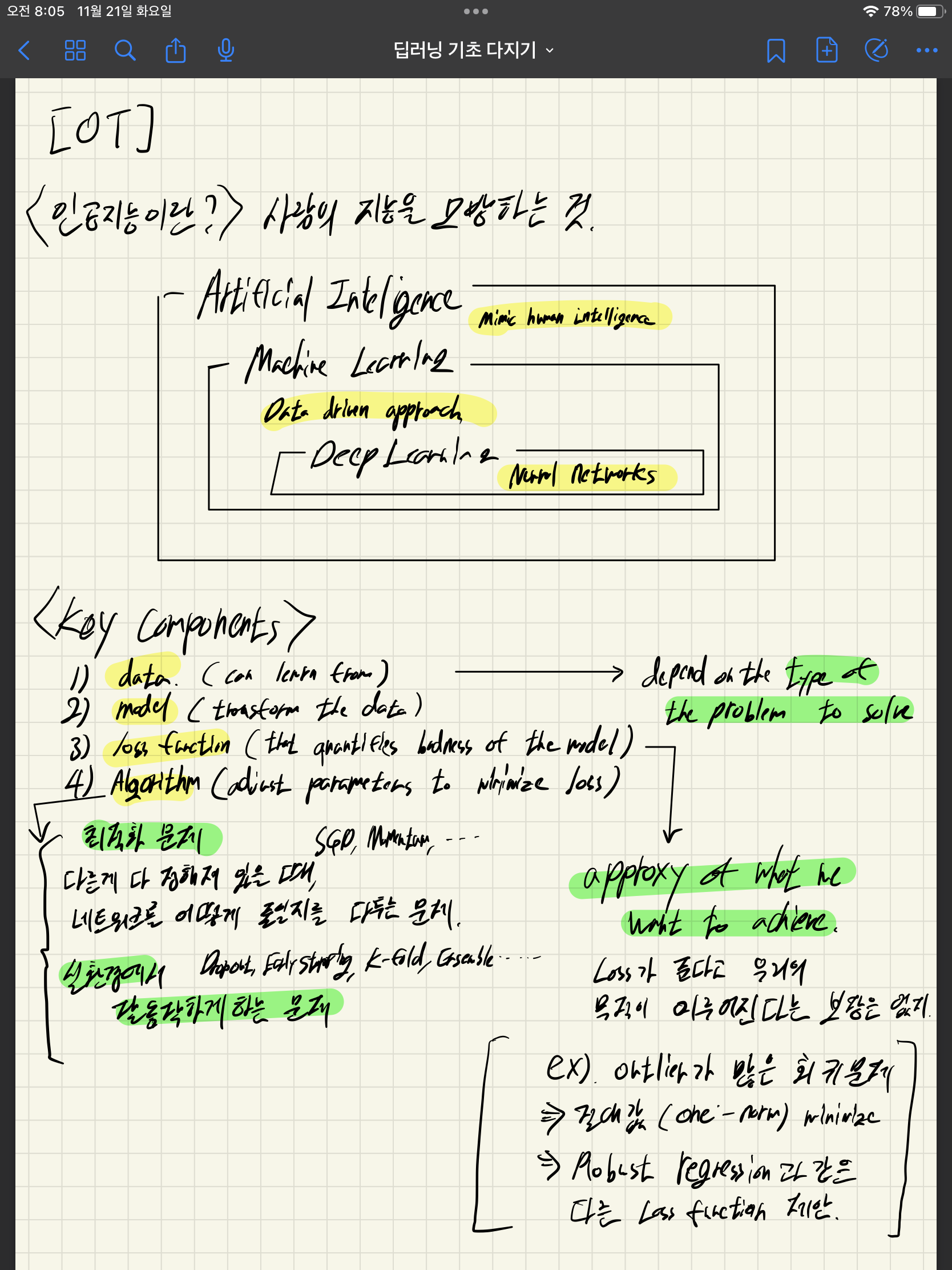

인공지능? 머신러닝? 딥러닝?

A Historical Review

- chatgpt 시대 이전, 딥리닝의 패러다임슈트에 대해 알아보자.

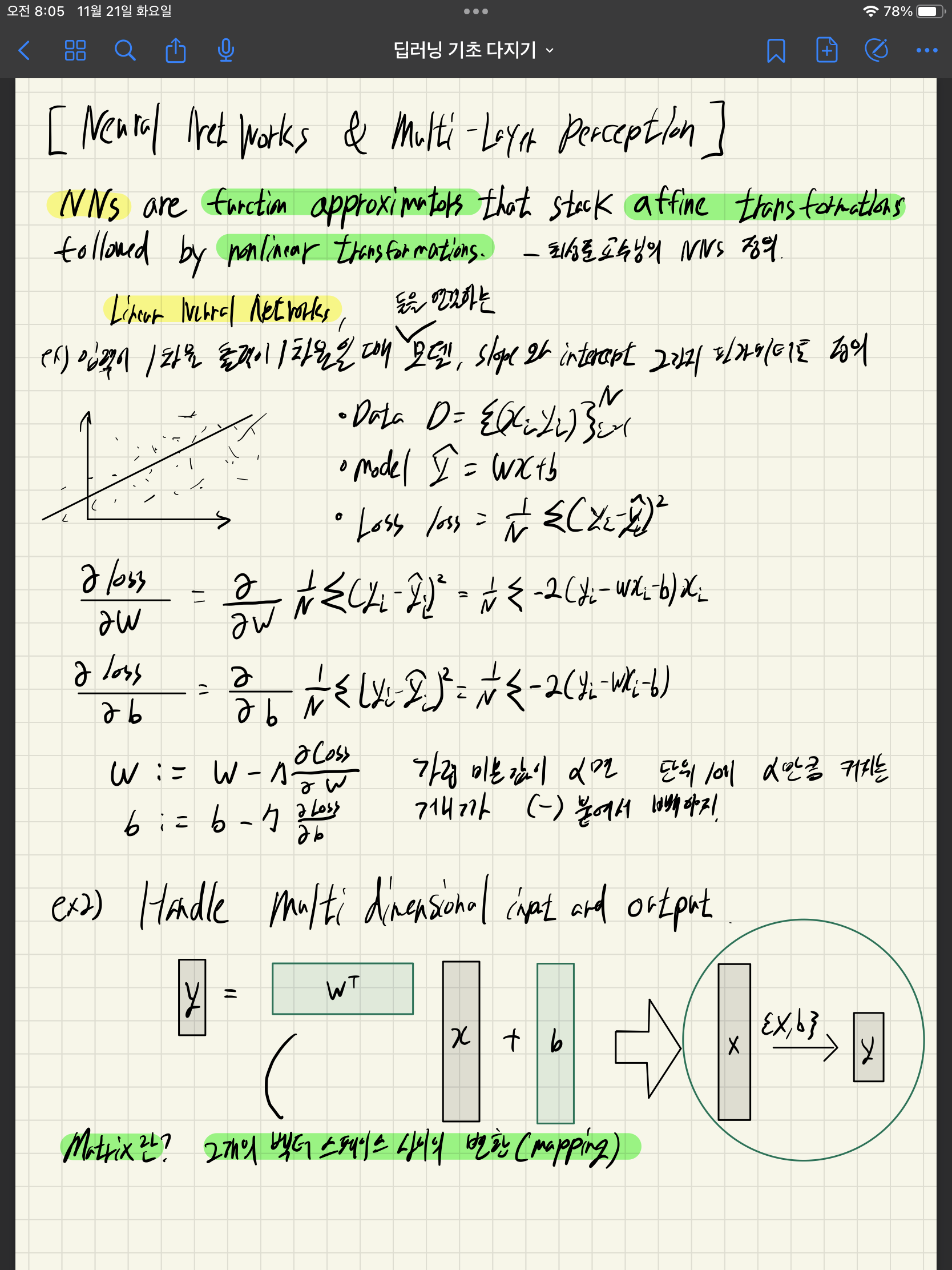

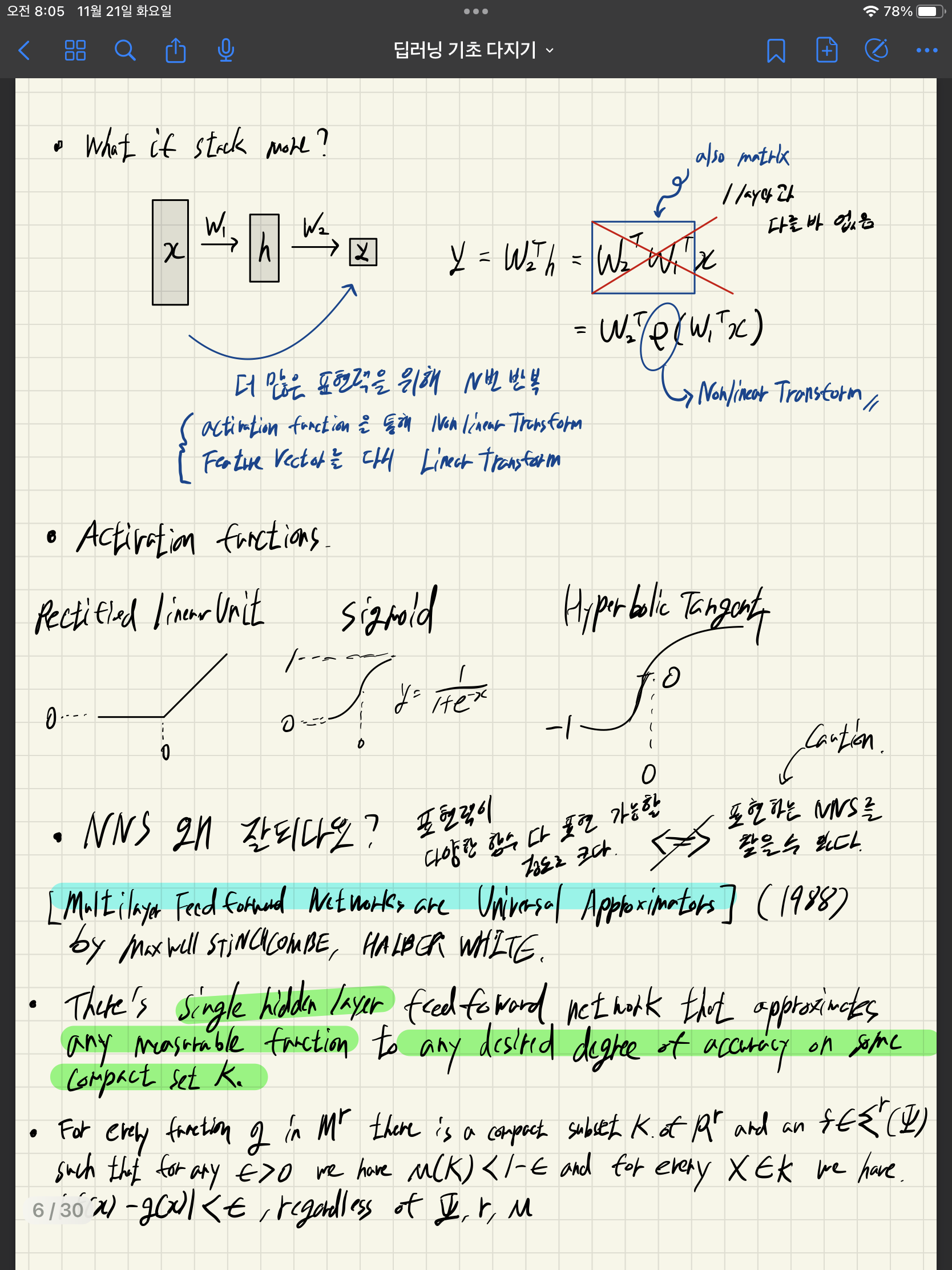

NNs

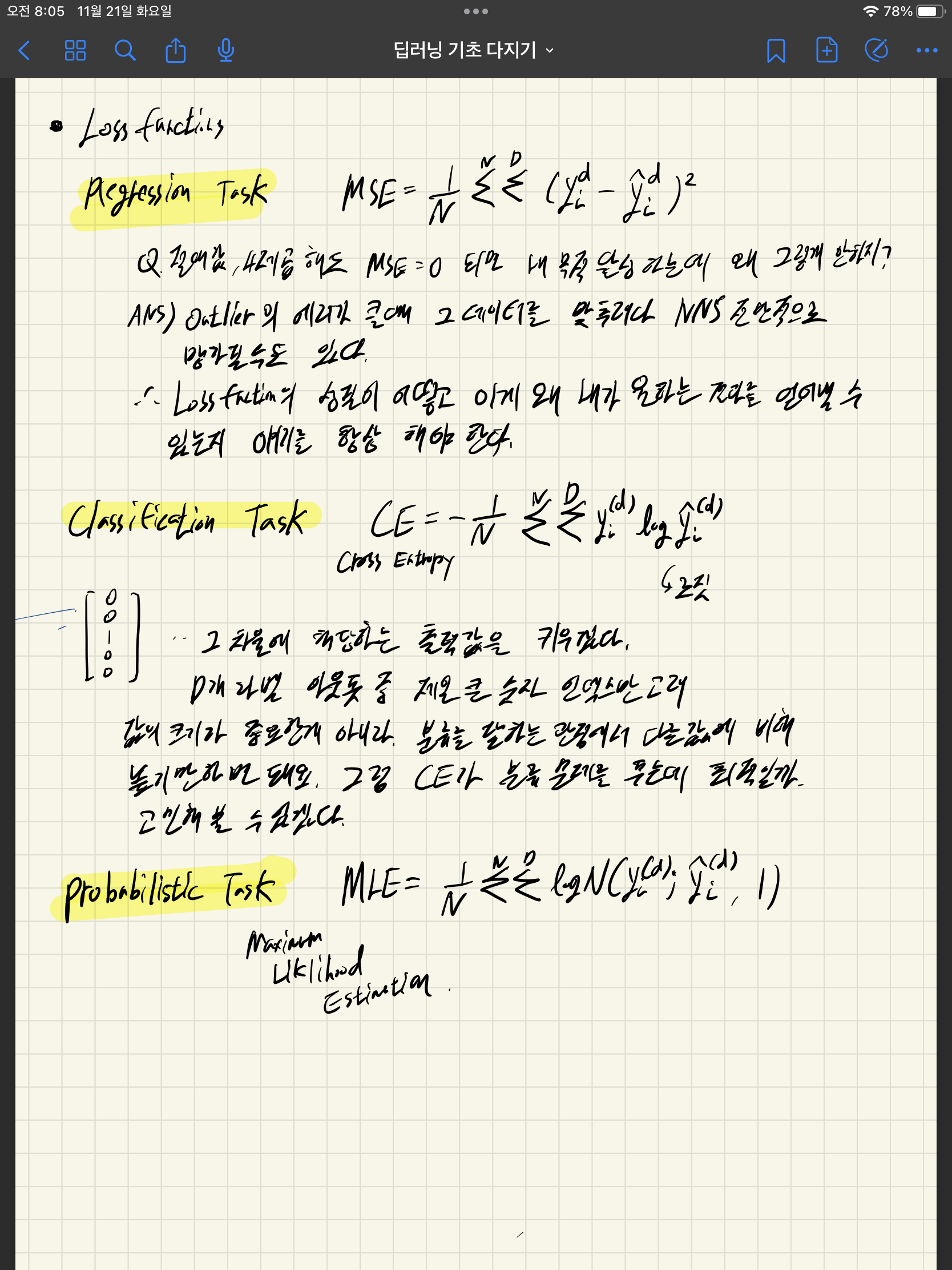

Loss Functions

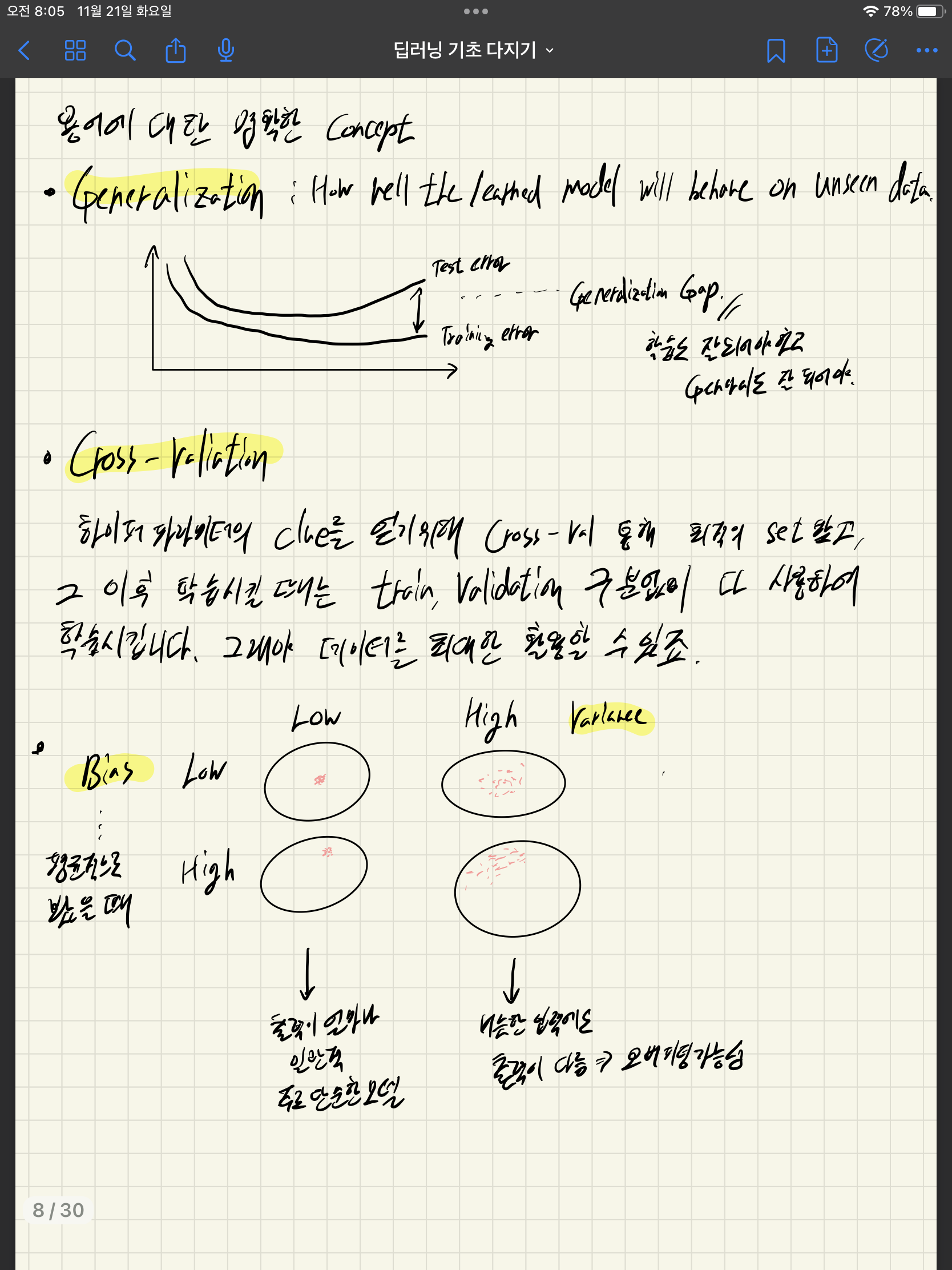

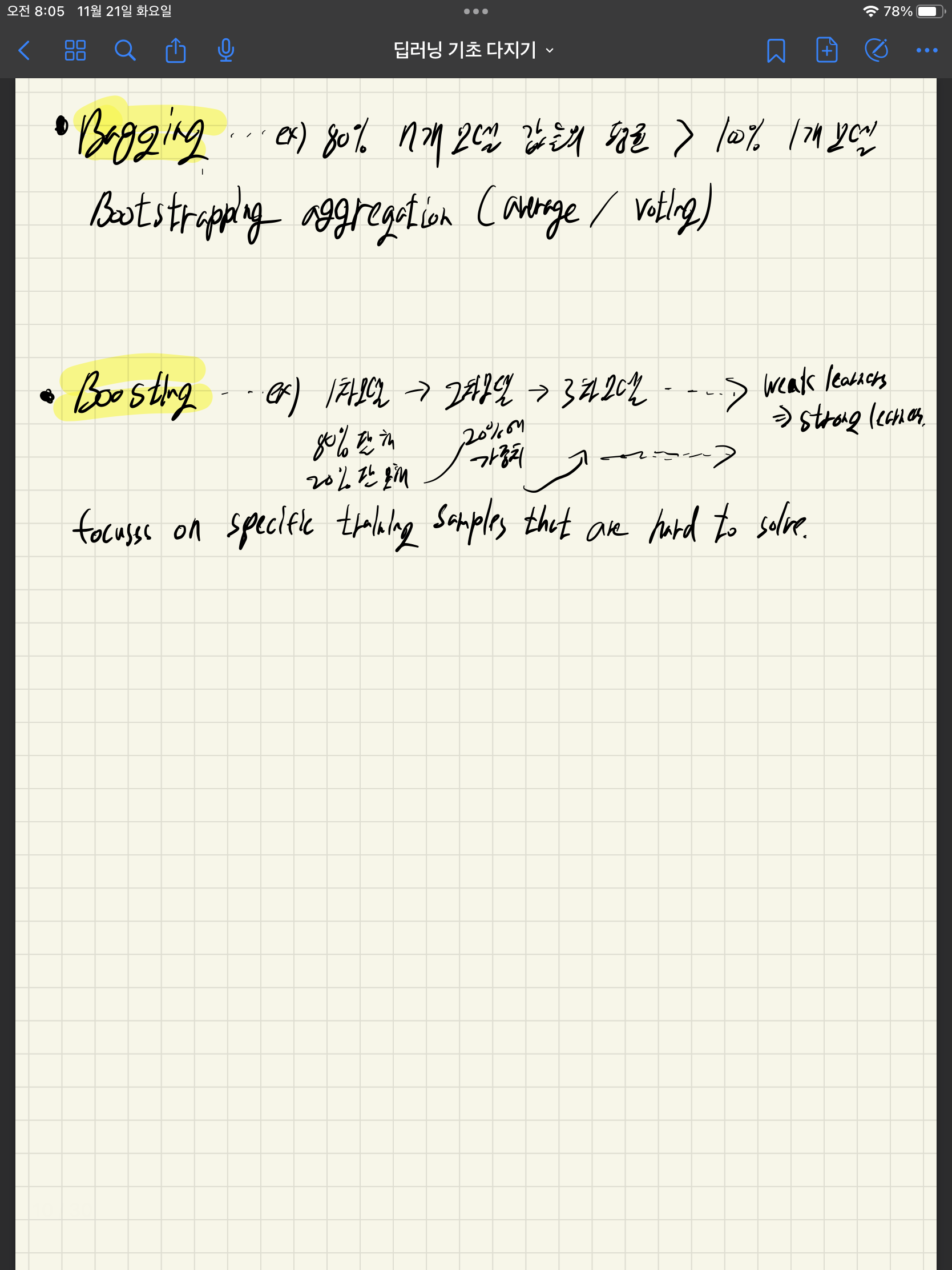

딥러닝 용어

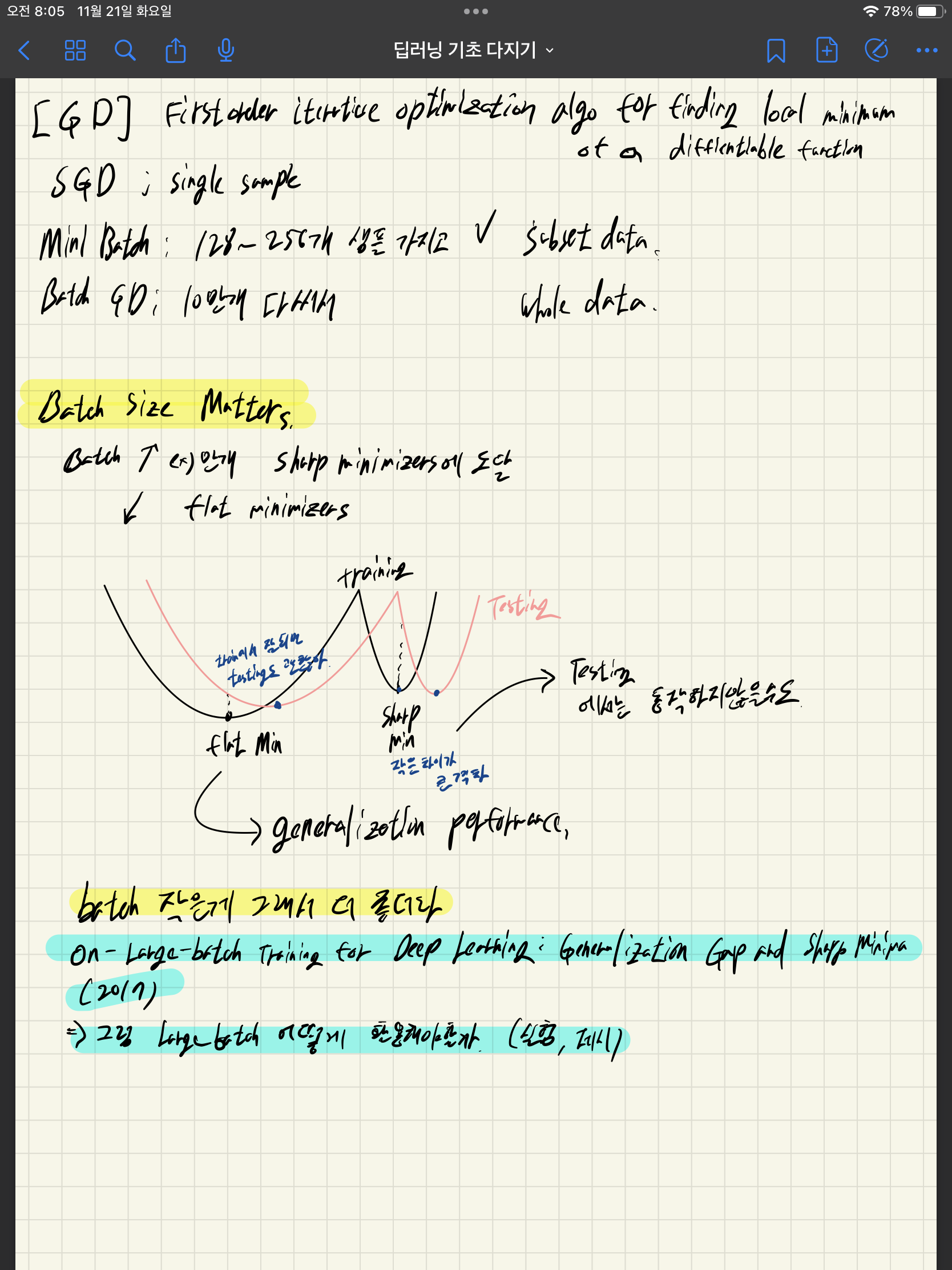

Gradient Descent

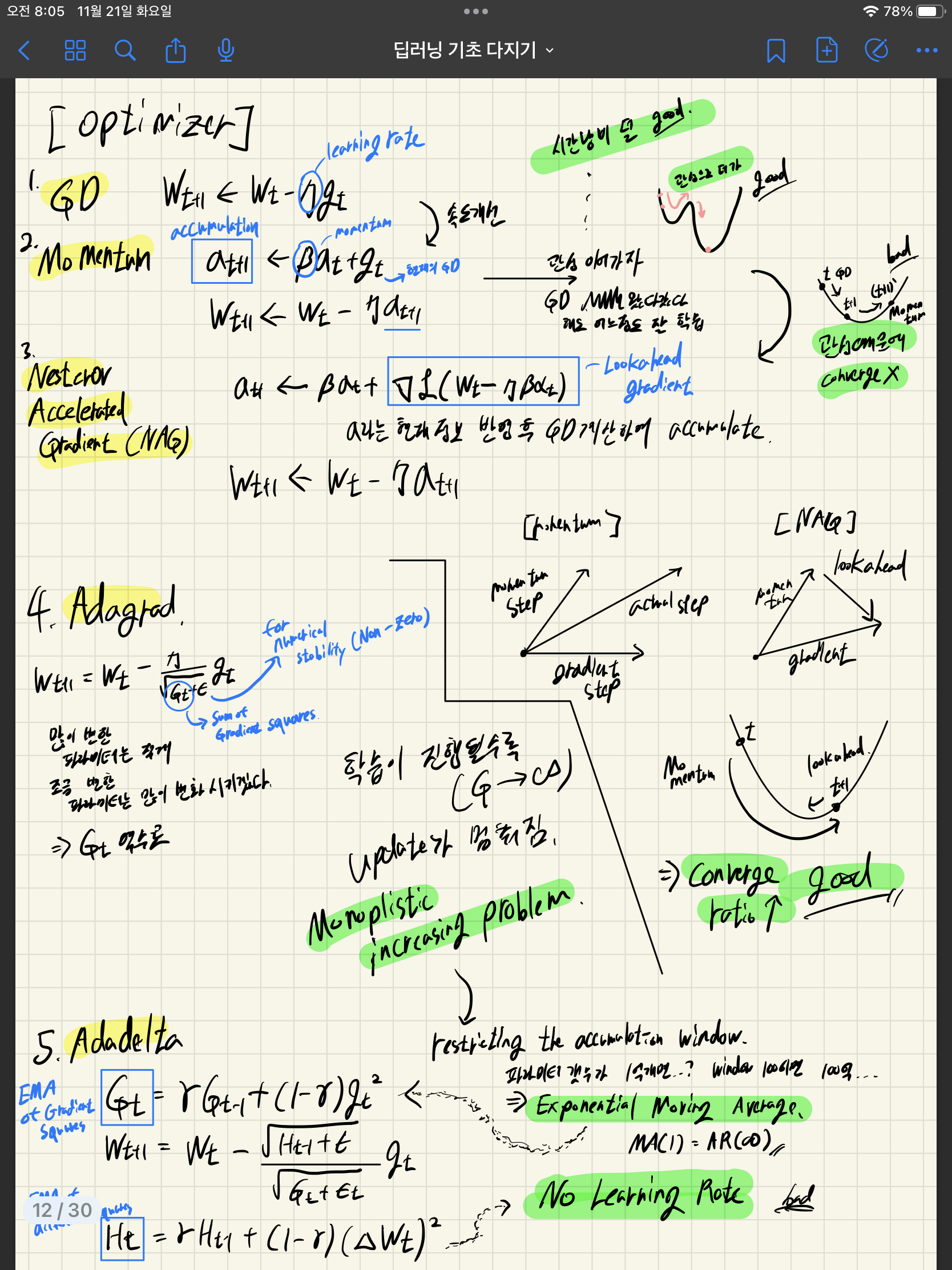

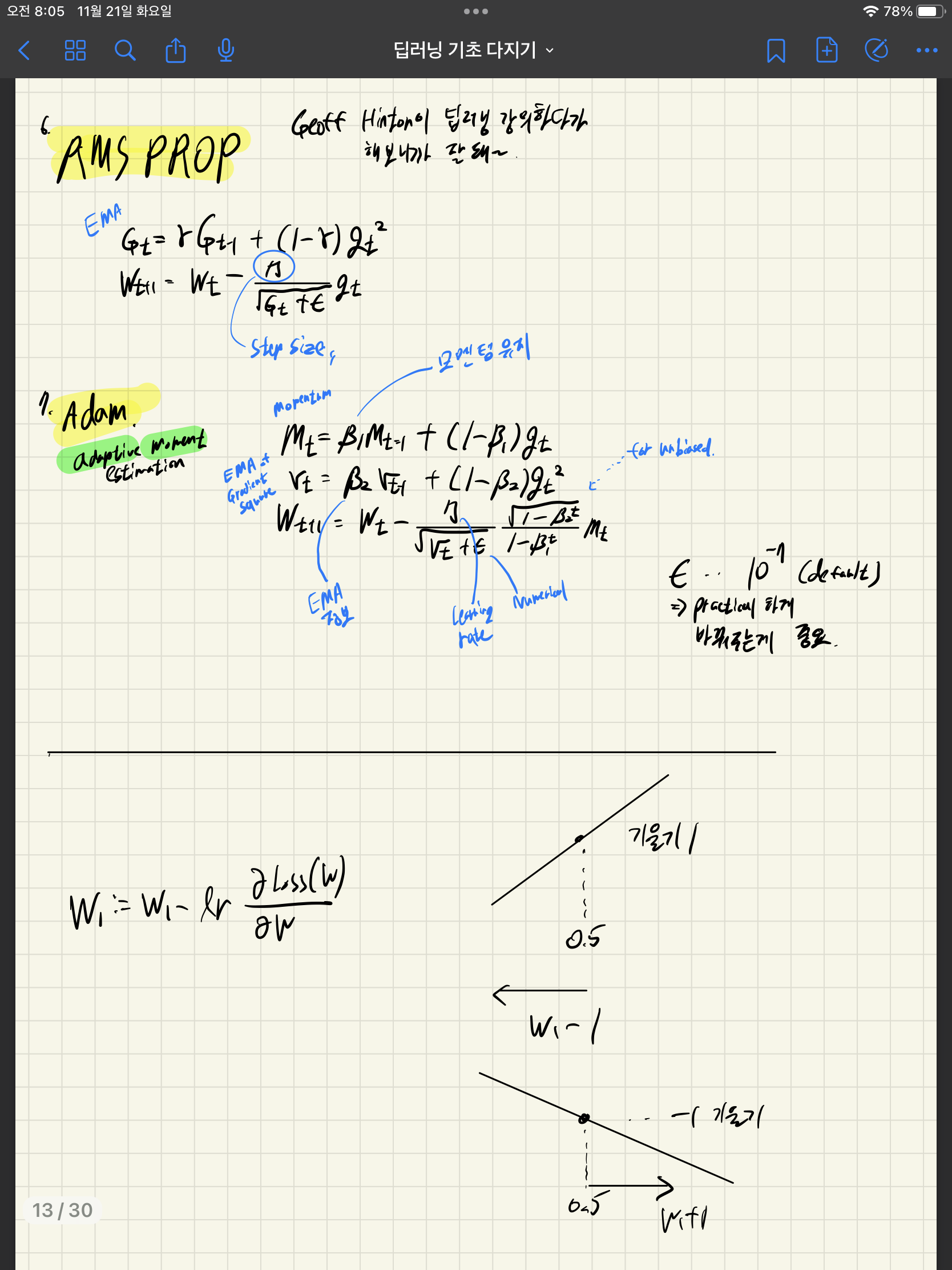

Optimizer

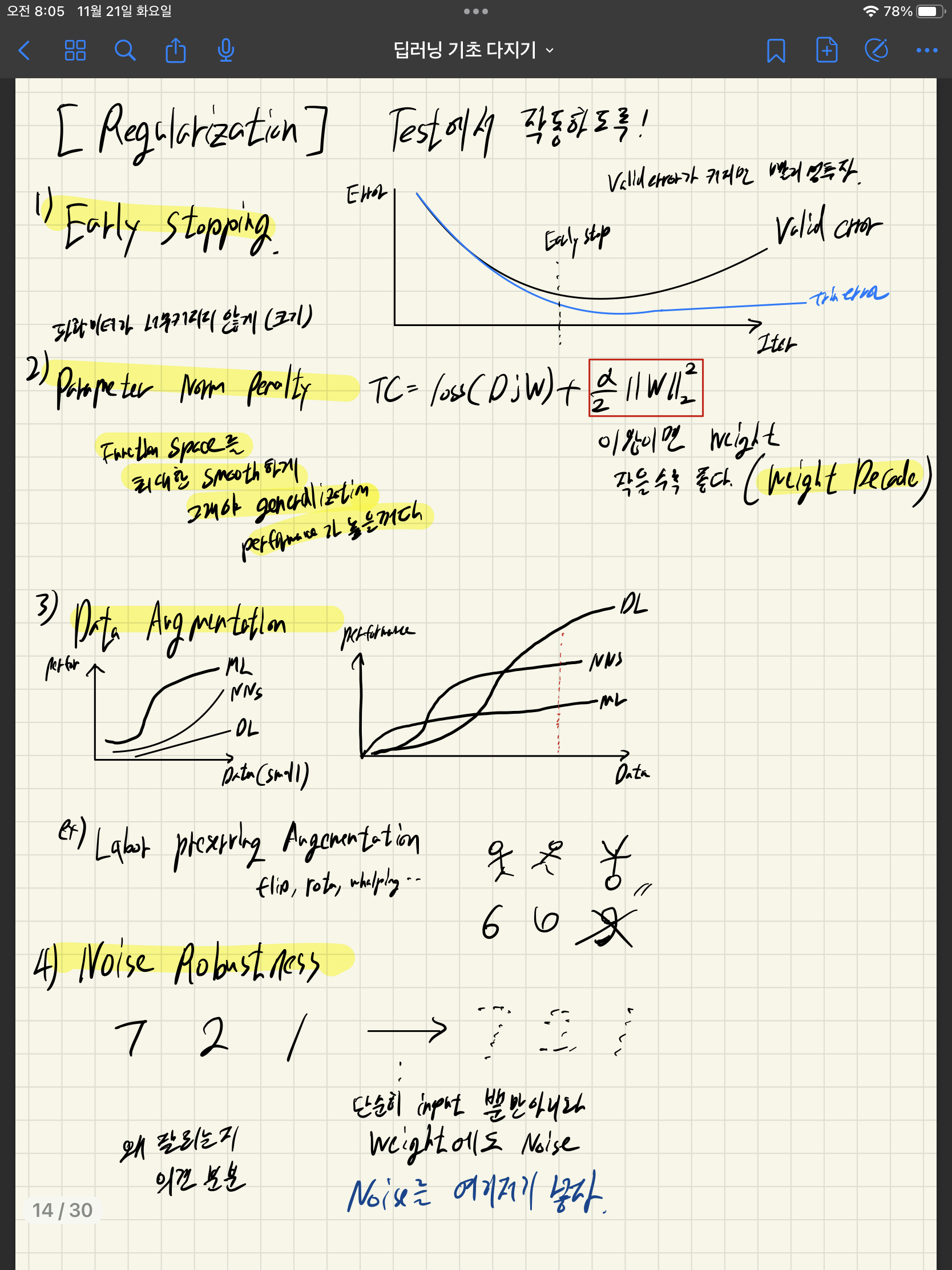

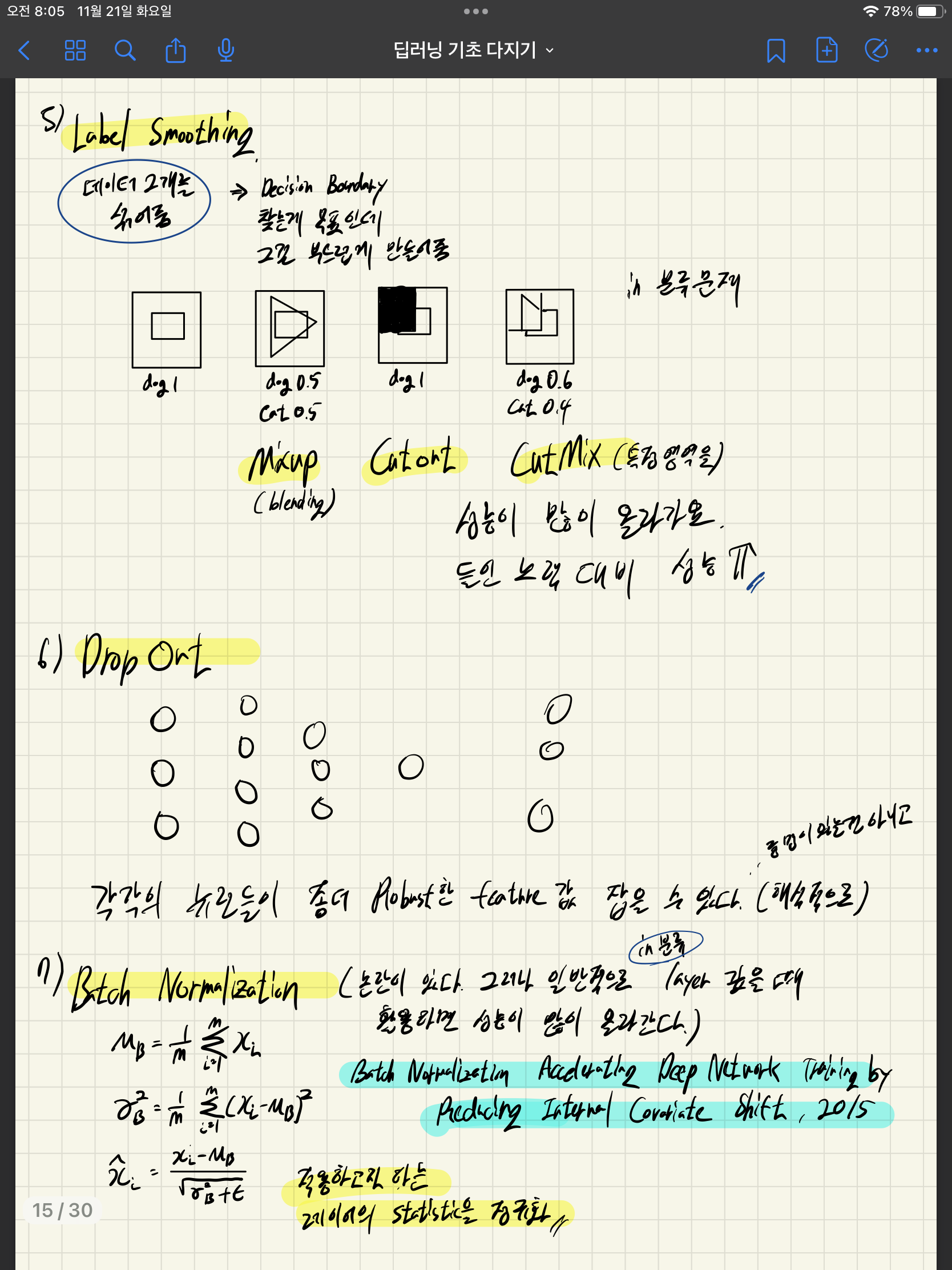

Regularization

출처 : boostcamp 최성준 교수님 강의 내용 공부 및 정리

가중치 초기화

https://callmescone.tistory.com/365

가중치 초기화 (Weight Initialization)

Weight decay Parameter Norm Penalty Overfitting 방지 Weight 를 작게 유지하여 Function Space를 Smooth 하게 함.( For Generalization Performance ) 작게 유지? 가중치의 초깃값을 0으로 설정하면 어떨까? Zero Initialization 모든

callmescone.tistory.com

'근황 토크 및 자유게시판 > TIL' 카테고리의 다른 글

| TIL 겸 주간회고록 (d-40) (0) | 2023.12.15 |

|---|---|

| [Transformer & Generative Models] 부트캠 day-17 (1) | 2023.11.23 |

| [Pytorch] 네부캠 day-12 (0) | 2023.11.17 |

| [Pytorch] 네부캠 day-11 (0) | 2023.11.17 |

| [Pytorch] 네부캠 day-10 (1) | 2023.11.16 |